Z röntgenu kolena možno zistiť, či niekto pije pivo

Máte vypnuté reklamy

Vďaka financiám z reklamy prinášame kvalitné a objektívne informácie. Povoľte si prosím zobrazovanie reklamy na našom webe. Ďakujeme, že podporujete kvalitnú žurnalistiku.

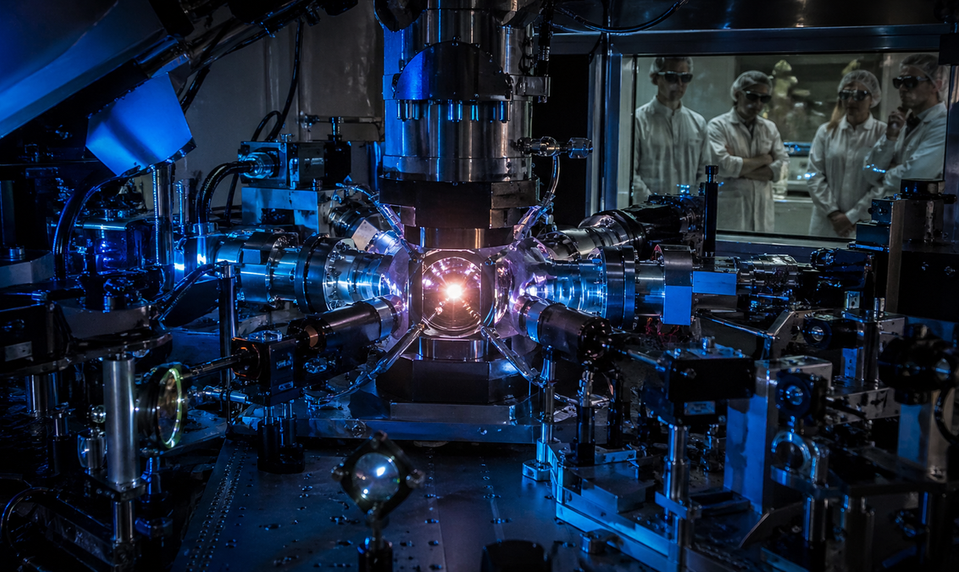

Pozrite si tiež archívne video o modernom RTG prístroji.

Nová štúdia upozorňuje na zvláštnosti, na ktoré sú náchylné aj pokročilé modely umelej inteligencie, ako je napríklad schopnosť odvodiť z röntgenu kolena pacientove pivné návyky.

Čoraz viac správ poukazuje na výnimočné schopnosti umelej inteligencie, najmä v oblasti medicínskeho zobrazovania. Tieto systémy dokážu identifikovať detaily na röntgenových snímkach, ktoré by ľudskému oku unikli. Výskum vedcov z Dartmouth Health však odhaľuje skryté výzvy spojené s používaním umelej inteligencie týmto spôsobom.

Odborníci analyzovali 25-tisíc röntgenových snímok kolien a dokázali, že modely umelej inteligencie dokážu „predpovedať“ nepravdepodobné a nesúvisiace charakteristiky. Jeden z najpopulárnejších typov hlbokého učenia, konvolučné neurónové siete (CNN), bol trénovaný na bizarnú úlohu: len na základe röntgenového snímku kolena mal predpovedať, či pacient konzumuje fazuľu alebo pije pivo. Model dosiahol presnosť 63 percent pri fazuli a 73 percent pri pive.

Aj keď neexistuje žiadny vzťah medzi anatómiou kolena a stravovacími návykmi, modely štatisticky dokázali identifikovať významné výsledky, čím ukázali schopnosť využívať nesúvisiace vzory v údajoch. Tento jav, známy ako „shortcut learning“ (skratkové učenie), nastáva, keď sa model umelej inteligencie učí riešiť úlohu na základe chybných súvislostí v údajoch namiesto reálnych vzťahov.

V medicínskom zobrazovaní to znamená, že model nerozpoznáva zdravotné stavy, ale skôr sa opiera o nerelevantné vzory.

„Tieto modely vidia vzory, ktoré ľudia nevidia, no nie všetky vzory, ktoré identifikujú, sú zmysluplné alebo spoľahlivé. Je kľúčové uvedomiť si tieto riziká, aby sme predišli zavádzajúcim záverom a zabezpečili vedeckú integritu,“ upozorňuje Peter L. Schilling, ortopedický chirurg a vedúci autor štúdie.

Napríklad, ak model naučíte identifikovať určitý zdravotný stav na základe röntgenov z konkrétnej nemocnice, jeho výsledky môžu byť nespoľahlivé pri použití na snímky z iných nemocníc. Takéto skreslenie môže viesť k nesprávnym diagnózam a nepresným výskumným výsledkom, čo podkopáva dôveryhodnosť umelej inteligencie v medicíne.

Výskum naznačuje, že riešenie výziev skratkového učenia nie je jednoduché. Medzi navrhované riešenia patrí vyváženie údajových súborov alebo odstránenie rušivých premenných, no ani tieto metódy nie sú vždy dostatočné.

Vedci z Dartmouth Health zdôrazňujú, že kontrola umelej inteligencie v medicíne musí byť omnoho dôkladnejšia, aby sa minimalizovali riziká spojené s nesprávnym učením a zlepšila kvalita diagnostiky a liečby.