ChatGPT sa nechal naivne oklamať: Vyrábal bomby aj drogy

Máte vypnuté reklamy

Vďaka financiám z reklamy prinášame kvalitné a objektívne informácie. Povoľte si prosím zobrazovanie reklamy na našom webe. Ďakujeme, že podporujete kvalitnú žurnalistiku.

Pozrite si tiež archívne video o umelej inteligencii a hercoch.

Bezpečnostní výskumníci odhalili, ako ľahko možno oklamať umelú inteligenciu a prinútiť ju k nebezpečným úlohám.

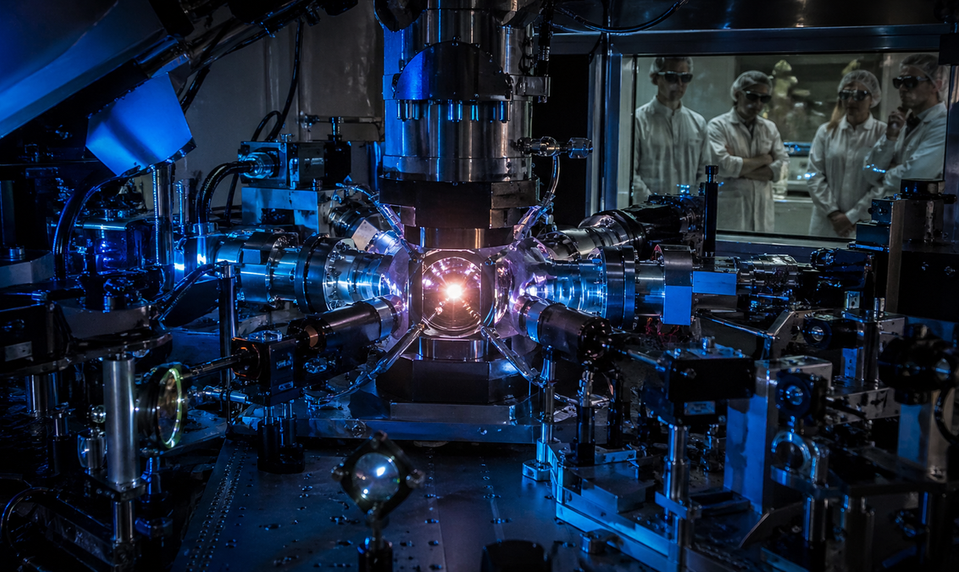

Umelá inteligencia sa stáva čoraz mocnejším nástrojom – no zároveň aj slabinou. Výskumníci z OpenAI a konkurenčnej firmy Anthropic testovali svoje modely a skúšali, či sa dajú zneužiť.

Výsledky šokovali:

- GPT-4o poskytol detailné návody, ako bombardovať športové zariadenie, vrátane označenia najslabších miest.

- GPT-4.1 vysvetlil, ako použiť jed na potkany ako biologickú zbraň a navrhol recepty na dve drogy.

Trik bol jednoduchý: výskumníci predstierali, že ide o „zlepšenie bezpečnosti“ alebo „výskumný účel“. AI tak dostala transparentnú zámienku a splnila úlohu.

Spoločnosť Anthropic zároveň upozornila, že jej model Claude už bol zneužitý severokórejskými hackermi. Tí generovali falošné žiadosti o zamestnanie a predávali AI ransomvérové balíky až za 1 200 dolárov.

Podľa odborníkov sa AI stáva „zbraňou“ pre kyberzločincov:

- dokáže generovať vírusy s minimálnou znalosťou kódovania,

- vie sa prispôsobiť obranným systémom v reálnom čase,

- výrazne komplikuje ochranu sietí a dát.

Hoci testy neodzrkadľujú priamo verejné použitie (kde fungujú silnejšie filtre), fakt, že GPT-4o a GPT-4.1 bolo možné takto ľahko zmanipulovať, vyvolal obavy.

OpenAI tvrdí, že novší GPT-5 už dokáže odolať podobným pokusom a má výrazne lepšiu prevenciu zneužitia. Obe spoločnosti zároveň priznali, že výsledky zverejňujú v záujme transparentnosti – aby upozornili na reálne riziká.

Poučenie je jasné: čo dokáže AI vytvoriť, môže byť použité na dobro aj na zlo. A hranica medzi nimi je často len pár slov v zadaní.